ChatGPT un citi mākslīgā intelekta (MI) jeb angliski artificial intelligence (AI) rīki ir ērti izmantojami dažādu ikdienišķu uzdevumu veikšanai - tie var palīdzēt iegūt informāciju, sagatavot prezentācijas, anotācijas, pārskatus, aptaujas, uzrakstīt programmatūras kodu un vēl, un vēl.

Taču arī ar mākslīgā intelekta rīkiem, tāpat kā ar jebkuru citu rīku, jāievēro vairāki piesardzības pasākumi, lai rīku varētu izmantot droši. Papildus jāņem vērā tas, ka lielo sabiedrības interesi par MI cenšas izmantot arī krāpnieki.

Rekomendējamie piesardzības pasākumi:

- Meklējot informāciju par MI risinājumiem, piesardzīgi izturieties pret Google un citu meklētāju rezultātiem. Uzbrucēji mēdz izmantot apmaksātas reklāmas, kas parādās meklējamo rezultātu augšgalā un ved uz ļaundabīgām vietnēm. Viltus vietņu adreses bieži tiek veidotas tā, lai tās būtu līdzīgas oriģinālajām vietnēm. Google meklētājā reklāmas var atpazīt pēc atzīmes “Ad” (reklāma). Lai vestu apmeklētājus uz ļaundabīgu saturu, tiek izmantoti arī apmaksāti ieraksti un viltus profili sociālajos tīklos.

- Izmantojot MI popularitāti, dažādi izstrādātāji piedāvā lejupielādēt gan lietotnes, gan interneta pārlūku paplašinājumus (extensions). Pirms jebko lejupielādēt un sniegt tam piekļuvi savai iekārtai, jāpārbauda izstrādātājs, tā reputācija, citu lietotāju komentāri par rīku, jo potenciālās iespējas ir tik vilinošas, ka uzbrucēji papūlas apiet oficiālo vietņu drošības filtrus un nodrošināt ļaundabīgās programmatūras nokļūšanu Chrome Web Store vai Google Play. Pēc uzstādīšanas šīs lietotnes vai paplašinājumi, paralēli reklamētajai funkcionalitātei, var veikt arī lietotāja datu zagšanu un kontu pārņemšanu.

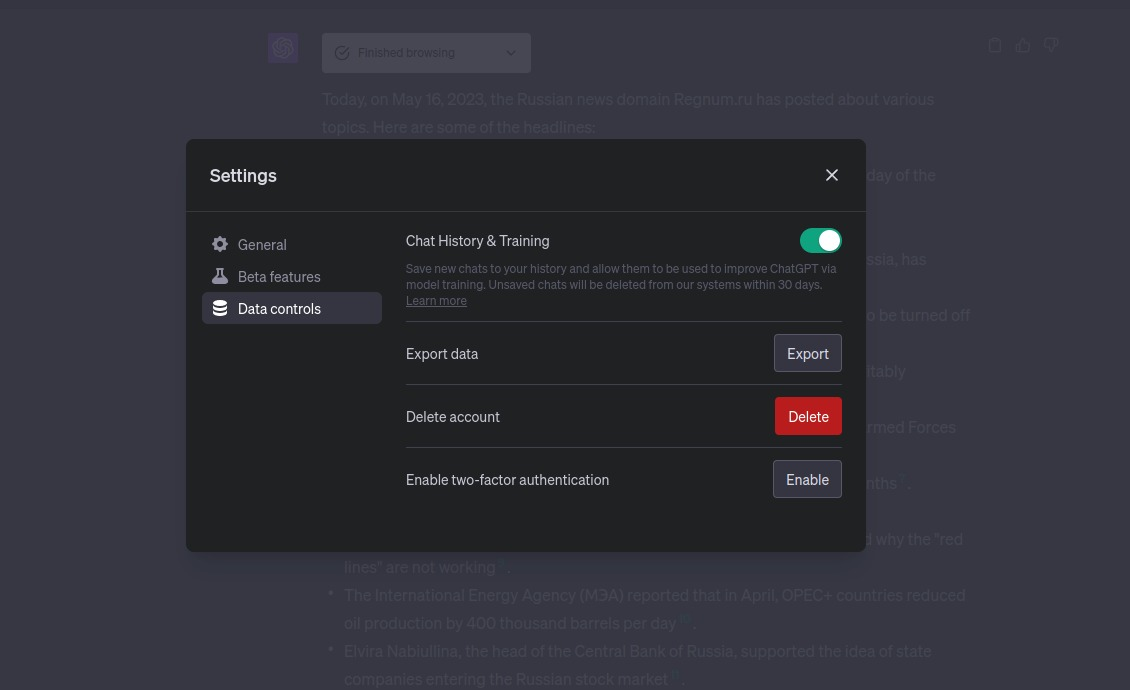

- Izmantojot ChatGPT vai jebkuru citu rīku, nevadiet rīkā personas datus un citu sensitīvu vai ierobežotas pieejamības informāciju. Rīks mācību nolūkiem saglabā visu, kas tajā tiek ievadīts, un var izmantot šo informāciju, ģenerējot atbildes uz citu cilvēku vaicājumiem.

- ChatGPT tiek piedāvāta iespēja atslēgt vaicājumu vēstures saglabāšanu (Chat History & Training slēdzītim jābūt pelēkam), potenciāli nodrošinot to, ka ievadītie dati netiks saglabāti un tālāk izmantoti, bet pārbaudīt to ir grūti. Arī citiem MI rīkiem varētu būt līdzīgas atteikšanās (opt-out) iespējas.

- Akli neuzticieties rīka ģenerētajam rezultātam - veiciet datu un faktu pārbaudi, pārliecinieties, ka atbilde ir loģiska un patiesa (MI jāuztver kā papagailis, kas iemācījies ticami savirknēt vārdus, bet neizprot to nozīmi).

- Ņemiet vērā, ka rīka sniegtās atbildes var būt tendenciozas, jo, iespējams, MI mācību procesā izmantotais materiāls ir bijis subjektīvs vai ticis nekorekti interpretēts.

- Esiet piesardzīgi, izmantojot MI radīto rezultātu publiski, jo šobrīd līdz galam nav noregulēts MI radītā materiāla autortiesību jautājums (MI mācību materiāls un radītais rezultāts, iespējams, satur ar autortiesībām aizsargātu informāciju).

- Uzņēmumos un organizācijās jāizstrādā iekšējie noteikumi MI izmantošanai darba vajadzībām. Tā vietā, lai aizliegtu MI izmantošanu, jāveic darbinieku izglītošana, skaidrojot ko, kā un kāpēc darīt vai nedarīt.

- Pastāv arī iespēja darbināt pašiem savu MI valodas modeļa (Large Language Model) instanci, piemēram, Alpaca, Vicuna, Open assistant u.c., kas potenciāli sniegtu lielākas privātuma garantijas, ja modelim tiktu liegta piekļuve internetam.

- Daļa MI rīku piedāvā savus pakalpojumus vai papildu funkcionalitāti par maksu. Šādiem gadījumiem, tāpat kā citiem pirkumiem internetā, rekomendējam ieviest atsevišķu bankas norēķinu karti. Šajā kartē ieteicams turēt tikai tādu naudas summu, kāda nepieciešama konkrētam pirkumam. Tas pasargās jūs no zaudējumiem gan, ja izvēlētā MI rīka izstrādātāji nebūs parūpējušies par pietiekamu drošību un uzbrucējiem būs izdevies piekļūt lietotāju datiem, gan arī, ja izvēlētais MI pakalpojums tomēr izrādīsies krāpniecība un uzbrucēji būs ieguvuši jūsu maksājumu un/ vai kartes datus.

Vairāk:

ChatGPT un datu noplūdes:

https://gizmodo.com/chatgpt-ai-samsung-employees-leak-data-1850307376

Ļaundabīgi pārlūkprogrammu spraudņi:

https://www.youtube.com/watch?v=LO2ivPtC3pg

https://www.bleepingcomputer.com/news/security/facebook-accounts-hijacked-by-new-malicious-chatgpt-chrome-extension/

AI un autortiesības:

https://intellectual-property-helpdesk.ec.europa.eu/news-events/news/intellectual-property-chatgpt-2023-02-20_en

Iekšējo noteikumu paraugs AI izmantošanai:

https://team8.vc/wp-content/uploads/2023/04/Team8-Generative-AI-and-ChatGPT-Enterprise-Risks.pdf (Appendix 2)

AI izmantošana piekļuves informācijas un citu sensitīvu datu ieguvei:

https://www.trendmicro.com/en_us/research/22/a/codex-exposed--exploring-the-capabilities-and-risks-of-openai-s-.html

Lokāls LLM:

https://open-assistant.io/

https://www.youtube.com/watch?v=ddG2fM9i4Kk

https://arxiv.org/pdf/2106.09685.pdf (fine tuning with LoRa)

https://www.youtube.com/watch?v=xslW5sQOkC8, https://crfm.stanford.edu/2023/03/13/alpaca.html (fine tuning, Alpaca)

Attēls: pixabay.com

ChatGPT un citi mākslīgā intelekta (MI) jeb angliski artificial intelligence (AI) rīki ir ērti izmantojami dažādu ikdienišķu uzdevumu veikšanai - tie var palīdzēt iegūt informāciju, sagatavot prezentācijas, anotācijas, pārskatus, aptaujas, uzrakstīt programmatūras kodu un vēl, un vēl.

Taču arī ar mākslīgā intelekta rīkiem, tāpat kā ar jebkuru citu rīku, jāievēro vairāki piesardzības pasākumi, lai rīku varētu izmantot droši. Papildus jāņem vērā tas, ka lielo sabiedrības interesi par MI cenšas izmantot arī krāpnieki.

Rekomendējamie piesardzības pasākumi:

Vairāk:

ChatGPT un datu noplūdes:

https://gizmodo.com/chatgpt-ai-samsung-employees-leak-data-1850307376

Ļaundabīgi pārlūkprogrammu spraudņi:

https://www.youtube.com/watch?v=LO2ivPtC3pg

https://www.bleepingcomputer.com/news/security/facebook-accounts-hijacked-by-new-malicious-chatgpt-chrome-extension/

AI un autortiesības:

https://intellectual-property-helpdesk.ec.europa.eu/news-events/news/intellectual-property-chatgpt-2023-02-20_en

Iekšējo noteikumu paraugs AI izmantošanai:

https://team8.vc/wp-content/uploads/2023/04/Team8-Generative-AI-and-ChatGPT-Enterprise-Risks.pdf (Appendix 2)

AI izmantošana piekļuves informācijas un citu sensitīvu datu ieguvei:

https://www.trendmicro.com/en_us/research/22/a/codex-exposed--exploring-the-capabilities-and-risks-of-openai-s-.html

Lokāls LLM:

https://open-assistant.io/

https://www.youtube.com/watch?v=ddG2fM9i4Kk

https://arxiv.org/pdf/2106.09685.pdf (fine tuning with LoRa)

https://www.youtube.com/watch?v=xslW5sQOkC8, https://crfm.stanford.edu/2023/03/13/alpaca.html (fine tuning, Alpaca)

Attēls: pixabay.com